Megvan az, amikor két barát beszélget a hétvégén és az egyik Ai szakértőként a másik Közösségi Érdekérvényesítőként mestere az Ai-nak, mi több: mindketten Ai-t használnak a munkájukhoz. Mindketten kiemelten jól tolják és minden tekintetben a saját szakterületük elismert szakemberei? Valahogy így kezdődött az a Júliusi hétvége is Kerek István Ai. specialista és az Adhoc Support CIC Érdekérvényesítő Közösség hétvégi beszélgetése, ahol az Ai rejtett veszélyeiről és az etika relációjáról beszélgettek. ( Istvánról jó tudni, hogy a CHATGPT Magyarul Facebook csoport alapítója és a Robotok Magyarul csoport alapítójaként is, igen közismert és közkedvelt Ai szakember.) Aztán Kerek István gondolt egyet, és ahogyan az utca ismeri a poént: „Fogd meg a söröm” – felkiálltással…eltűnt a vonalból. Na ez is eltűnt – min is törheti az agyát…- gondolta Zoltán és Géza az Adhoc Support CIC-nál – akik meg az MBH Bank Google csalási ügy un. digitális botrányának háttereként váltak hetek alatt ismertekké Magyarországon és pont az Ai -ról beszélgettek, az Ai illúziókról és az Ai alapú átverésekről. István meg egyszerűen hopsz…

Másnap reggel érkezett egy videó, István küldte Tik-Tokon: ránéztünk és egy medve ugrált egy trambulinon – szólt Géza az Adhoc Support csapatból, a történet folytatásaként. Egy medve volt a videón, amint egy békés otthonba betért és ott trambulinozni kezdett. Döbbenet, hogy sikerülhetett ezt felvenni Istvánnak, gondolták az Adhoc Supportosok, de a videó minden képzeletüket felülmúlta.

Telefon Istvánnak. Gratuláció, meg hogy: „Micsoda videó ez! Hát végül is hogyan sikerült elkapni ezt a pillanatot, amikor a medve és a trambulin…” Mire István: – Sehogy. – Mi? De hát a videón trambulinon ugrál a medve, aztán reccs… – Ja… ááá… az csak AI – szólalt meg István. És nagy csend lett.

Mi van? Ez nem lehet – olyan valósághű! Ez igazi!

De István elmondta, hogy ez biz Ai, és ezért tűnt el nagy lelkesen, hogy bebizonyítsa: a szemünk azt hisz, amit akar, a valóság meg az ami és nem Ai. Ebből született meg az a TIK-TOK SZTÁR: a TAMBULINON UGRÁLÓ MEDVE, aminek jelen állapotában, közel 80 millió megtekintés mellett, a medve lassan a világ legnézettebb Ai videója lett, de Magyarországon még Ai videó ekkora nézettséget nem ért el.

Az ügy súlyos csattanója az illúziókról és megtévesztésről, hogy közben már két amerikai ügynökség akarta megvásárolni reklámhoz a MEDVE videót. Lelkesen tették ajánlatukat, mire István hideg zuhanyként megírta: bocs srácok, ez egy kísérlet. Cikkünk erről a faramuci helyzetről szól: mit látunk, mit gondolunk és mennyire más Ai-al a világ egyben pedig, mennyire válik veszélyessé, ha rossz kezekbe kerül, és például megtévesztésre használják, ahogyan a „A 21. század legkifinomultabb banki csalásában volt részünk” – HVG Videóban Hámori Zsuzsi is megfogalmazta, az Adhoc Support önkénteseként.

#tudodki #mielottatvernek #euroastra #kamuwebshopok #istvankerek #kerekistvan #veo #chatgptmagyarul#digitalisfogyasztovedelem #adhocsupport #robotokmagyarul

@istvan.kerek Az AI medve sem játék… #istvankerek #kerekistvan ##veo #chatgptmagyarul #MesterségesIntelligencia #chatgptmagyarulfacebookcsoport #mi #ai @ChatGPT magyarul Fb. csoport ♬ BARBER OF SEVILLE – OVERTURE – Abaco

A vírusszerűen terjedő medve a digitális erdőben

Egy homályos, fekete-fehér, éjjellátó kamerával rögzítettnek tűnő felvétel kezdett megállíthatatlanul terjedni az interneten. A klipen egy medve látható, amint látszólag gyermeki örömmel ugrál egy kertvárosi trambulinon. A videó hipnotikus erővel hatott a globális közönségre, a megtekintések száma hamarosan meghaladta a 77 milliót, ezzel a Föld lakosságának közel 1%-ához jutott el. A reakciók azonnaliak és hevesek voltak: a szórakozott hitetlenkedéstől a tömeges felháborodásig terjedtek a „vadállatok éjszakai randalírozása” miatt. A kommentfolyamokat elárasztották a vélemények, miközben a videó megállíthatatlanul terjedt platformról platformra. A történetben azonban volt egyetlen, de annál lényegesebb csavar: a jelenetből egyetlen képkocka sem volt valódi.

Az egész egy precízen megtervezett és tudatosan végrehajtott kísérlet volt, amelyet Kerek István magyar mesterségesintelligencia-üzletfejlesztési szakértő indított útjára, hogy egyetlen, látszólag ártalmatlan videóval tesztelje a modern társadalom valóságérzékelésének határait. A „trambulinozó medve” így vált egy globális méretű társadalmi kísérlet szimbólumává, amely kíméletlen őszinteséggel mutatta meg a digitális kor sebezhetőségét.

Ez a cikk a trambulinon ugráló medve jelenségét, mint egy kulcsfontosságú kulturális pillanatot vizsgálja, amely messze túlmutat egy egyszerű internetes mémen. A medve egy allegóriává válik, amely a mesterséges intelligencia (MI) mély kettősségét szimbolizálja. Egy kritikus válaszúthoz érkeztünk, ahol el kell döntenünk, hogyan használjuk ezt a hatalmas technológiát. Dönthetünk úgy, hogy a dekonstrukció és a provokáció eszközévé tesszük, ahogyan azt a kísérlet demonstrálta, vagy választhatjuk a konstrukció és a megoldás útját, amelyet az AdhocSupport nevű közösségi érdekérvényesítő rendszer képvisel. A cikkünk központi tézise, hogy a medve esete egy ébresztő, amely rávilágít arra a sürgető szükségletre, hogy a technológiai fejlődéssel párhuzamosan fejlesszük a kritikus gondolkodásunkat és a társadalmi ellenállóképességünket is. A két bemutatott MI-alkalmazási modell – a provokatív megtévesztés és a közösségi felhatalmazás – közötti kontraszt rávilágít arra a fundamentális választásra, amellyel a 21. század társadalma szembesül.

Egy digitális illúzió anatómiája: A trambulinon ugráló medve dekonstrukciója

A trambulinon ugráló medve videójának elsöprő sikere nem a véletlen műve volt, hanem egy gondosan megtervezett, több rétegű stratégia eredménye, amely a technológiai bravúrt a digitális kultúra mély ismeretével ötvözte. A jelenség megértéséhez le kell bontanunk az illúziót annak alkotóelemeire: a technikai hamisítványra, a megtévesztés pszichológiai stratégiájára és az algoritmikus terjedés dinamikájára.

A technikai hamisítvány: Hogyan született a medve?

A videó alapja egy mesterséges intelligencia által generált infravörös felvétel (infra−felvétel) volt, amelyet Kerek István hozott létre. A hamisítvány meggyőző ereje a 2025-re elérhetővé vált, legmodernebb szöveg-videó (text−to−video) diffúziós modellek képességein alapult. Ezek a technológiák, mint például a Google Veo sorozata (amelyre Kerek a TikTok-posztjában a #veo hashtaggel kifejezetten utalt), az OpenAI Sora, a Kling vagy a Runway, forradalmasították a szintetikus médiatartalmak előállítását.

Ezeknek a modelleknek a kulcsfontosságú képességei közé tartozik a magas felbontás (1080p-től 4K-ig), a fotorealisztikus ábrázolás, a fizikai törvények valósághű szimulációja, az időbeli konzisztencia (a mozgás folyamatossága) és a szöveges utasítások (promtok) pontos követése. A Google Veo 3 modelljét, például úgy jellemezték, hogy „lenyűgöző, filmszerű videókat hoz létre hanggal”, „hihetetlen minőséggel” és „elképesztő prompt-követéssel és fizikai szimulációval” rendelkezik. A medve mozgásának természetessége, az ugrások dinamikája és a trambulin rugalmasságának látszata mind ezeknek a fejlett MI-képességeknek az eredménye.

A videó esztétikája – a szemcsés, fekete-fehér, éjjellátó kamerára emlékeztető stílus – tudatos és stratégiai döntés volt. Ez a vizuális megközelítés két célt szolgált egyszerre. Egyrészt növelte a hitelességet, mivel az ilyen típusú felvételek gyakoriak a biztonsági kamerák és a vadvilág-megfigyelő eszközök esetében, így a nézők számára ismerős kontextusba helyezte a jelenetet. Másrészt hatékonyan elfedte a mesterséges intelligencia által generált képek esetleges apróbb tökéletlenségeit, vizuális hibáit vagy „artefaktumait”, amelyek egy tiszta, nagy felbontású színes felvételen könnyebben észrevehetők lennének. Ez a technika a megtévesztés művészetének klasszikus példája: a forma nemcsak a tartalmat hordozza, hanem aktívan hozzájárul annak hihetővé tételéhez is.

A megtévesztés stratégiája: Mimikri és „húsvéti tojások”

A kísérlet zsenialitása nem egy teljesen új forgatókönyv kitalálásában rejlett, hanem egy már létező, virális tartalomtípus tökéletes utánzásában: a külvárosi kertekben, gyakran trambulinokon játszadozó medvékről készült valódi videók műfajának lemásolásában. A közönség már eleve fel volt készítve az ilyen jelenetekre a korábban széles körben elterjedt, valódi felvételek által. Kerek MI-medvéje nem anomália volt, hanem egy tökéletes hamisítvány, amelyet egy már létező, hiteles tartalmi áramlatba illesztettek be. Ez a „narratív mimikri” a szociális manipuláció egy kifinomult formája, amely túlmutat a puszta technikai hamisításon. A digitális kultúra és a mémetika mély megértését tükrözi, kihasználva a már meglévő mentális sémákat és elvárásokat a kritikai gondolkodás megkerülésére.

Mi is az a Mimicry – ( magyarul Mimikri vagy Mimikry) ?

A „mimikri” (mimikry) szó eredetileg a biológiából származik, ahol arra utal, hogy egy élőlény másik faj külsejét vagy tárgyak formáját utánozza, hogy előnyhöz jusson – például védelmet szerezzen vagy elriassza a ragadozókat. A trambulinozó medvéről szóló kísérletben ezt a fogalmat a digitális kultúrára ültették át: Kerek István szándékosan egy már létező, jól ismert tartalomtípust másolt le – a kertvárosi trambulinon ugráló medvékről készült valódi videók műfaját. Az MI‑videó azért volt meggyőző, mert a nézők korábban láttak hasonló, valós felvételeket, így az agyuk automatikusan „besorolta” a látottakat a hiteles emlékek közé. Ezt nevezi a jelentés „narratív mimikri”-nek: nemcsak technikai hamisításról van szó, hanem tudatos utánzásról, amely kihasználja a közönség meglévő mentális sémáit és elvárásait a kritikus gondolkodás megkerülésére.

Kerek István zseniális ötlete a tudat képtársításán alapult, ahogyan az Adhoc Support CIC az MBH Bank – Google csalásánál felismerte ezt a rejtett MIMIKRi-t és ezt, ültetve át a hétköznapi elme képtársításába, jött létre végül is a trambulinos medve elme-kép társítás. Ez volt a „fogd meg a söröm effektus lényege” : Kerek István „becsapta” az elmét, aki nem figyelt a lényegre és az emberek 99%-a, simán azt „látta”, hogy ez egy valódi élethelyzet. Bumm…”benézték” …mint a jól megtervezett Google csalás áldozatai az MBH Banknál.

A kísérlet részeként a videóban szándékosan elrejtettek apró, de árulkodó jeleket, úgynevezett „húsvéti tojásokat” (easter eggs), hogy teszteljék a nézők kritikai megfigyelőképességét :

- Egy alig észrevehető „AI” felirat a képen.

- Egy logikailag hibás időbélyeg, amely nem illett a jelenethez.

- A fizika törvényeinek ellentmondó, hibás árnyékok.

- a történet végén újra visszatérő ugyan azon medve fejrésze

Az eredmény lesújtó volt: a becslések szerint a nézők 99%-a valóságként fogadta el és osztotta tovább a felvételt, teljesen figyelmen kívül hagyva ezeket a nyomokat. Ez a digitális médiaműveltség kollektív, globális szintű kudarcát demonstrálja, és rávilágít arra, hogy az érzelmi hatás és a prekoncepciók mennyire felülírhatják a racionális elemzést.

Algoritmikus felerősítés és médiakontamináció

A videót tudatosan „vírusra hangolták” (vírusra hangolt és érzelem manipulatív), azaz úgy tervezték, hogy maximálisan kihasználja a közösségi média platformok, különösen a TikTok algoritmikus működését. A rövid, figyelemfelkeltő, érzelmeket kiváltó és könnyen megosztható tartalom minden olyan tulajdonsággal rendelkezett, amely a gyors terjedést segíti. Néhány óra leforgása alatt áttörte az algoritmikus gátakat, és rekordsebességgel járta be a világot.

A jelenség terjedésében kulcsszerepet játszott a nemzetközi sajtó is. Több hírportál tényként kezelte a történetet, ezzel tovább erősítve a hamisítvány legitimitását és hozzájárulva a globális félreértéshez.Ez rávilágít arra, hogy a sebezhetőség nemcsak az egyéni felhasználók szintjén, hanem a teljes média-ökoszisztémában is jelen van, ahol a gyors hírverseny gyakran felülírja az alapos ellenőrzés szükségességét.

Ezzel párhuzamosan azonban egy másik narratíva is kibontakozott. Számos online kommentátor és tartalomkészítő gyorsan felismerte a videó mesterséges eredetét, és leleplező tartalmakat kezdett gyártani. Ez a kettős percepció – az egyidejű hit és hitetlenség – a modern információs környezet egyik legjellemzőbb vonása. Míg a tömegek egy része kritikátlanul elfogadott egy illúziót, egy másik, kisebb, de hangosabb csoport aktívan dolgozott annak leleplezésén, létrehozva egyfajta digitális valósághasadást.

A kétértelműség építésze: Kerek István provokációja

A trambulinon ugráló medve kísérletének értékeléséhez elengedhetetlen megérteni az alkotó személyét, motivációit és a provokáció mögött meghúzódó filozófiát. A projekt nem egy egyszerű internetes tréfa volt, hanem egy komoly szakember tudatosan felépített akciója, amelynek célja a figyelemfelkeltés és a tanítás volt.

Egy „MI-evangélista” profilja

A kísérlet mögött álló személy nem egy névtelen troll, hanem Kerek István, egy elismert és hiteles szakember, akinek profilja alátámasztja a projekt komolyságát és tudatosságát.

Szakmai háttere egyértelművé teszi, hogy a medve-videó nem véletlen siker, hanem mély szakmai tudáson és a digitális trendek alapos ismeretén alapuló, tudatosan felépített provokáció.

Kerek István szakmai profiljának legfontosabb elemei:

- Tapasztalat: 2008 óta épít MI-alapú rendszereket, a szoftverektől a hardverekig, egyaránt dolgozott startupoknak és multinacionális cégeknek.

- Nemzetközi elismertség: A filmipar számára fejlesztett automatizált videógyártó rendszerei nemzetközi figyelmet kaptak, többek között Pekingben és Londonban is bemutatták őket.

- Közösségépítés: Szenvedélyes „MI-evangélista” és közösségépítő, aki olyan online szakmai csoportokat menedzsel, mint a 60 000 tagú „ChatGPT magyarul” vagy a 40 000 tagú „AI Business Development”. Összesen több mint 100 000 szakmai követővel rendelkezik.

- Oktatói tevékenység: Egyetemi óraadóként is tevékenykedik, ahol célja a médiaműveltség és a kritikai gondolkodás fejlesztése.

Ez a háttér kontextusba helyezi a kísérletet: egy olyan szakember indította útjára, aki mélyen ismeri a technológia lehetőségeit és veszélyeit, és felelősséget érez a társadalom felvilágosításáért.

A provokáció filozófiája

Kerek István a kísérletet egy filozófiai mélységű kérdéssel keretezte, amely túlmutat a technikai bemutatón: „Ha egy medve hajnali kettőkor trambulinozik az erdő szélén, és 76 millió ember látja – vajon tényleg megtörtént?”. Ez a kérdés a digitális korban újraértelmezi a híres „ha egy fa kidől az erdőben” dilemmát. A hangsúlyt a fizikai eseményről a kollektív észlelésre és a közösségi médiában konstruált valóságra helyezi. Azt sugallja, hogy egy bizonyos nézettségi szint felett a digitális kép valósága felülírhatja a fizikai valóság hiányát, és önálló, társadalmi tényként kezd létezni.

A provokáció mögött meghúzódó gondolkodásmódot talán a „villanykapcsoló” metaforája világítja meg a legjobban: „Az emberek a sötétben félnek az ismeretlentől. Én most felkapcsoltam a lámpát – és megmutattam, mennyire könnyű a sötétet újra előállítani egyetlen AI-kóddal. A következő lépés: megtanítani mindenkit a fénykapcsoló kezelésére”. Ebben a metaforában a „sötétség” a dezinformáció és a digitális manipuláció, amelytől az emberek joggal tartanak. A „lámpa felkapcsolása” maga a leleplező kísérlet, amely megmutatja a veszélyt, de egyben demisztifikálja is azt. Azzal, hogy megmutatja, milyen egyszerűen hozható létre az illúzió, elveszi annak misztikus erejét. A végső cél pedig a felhatalmazás: megtanítani mindenkinek, hogyan ismerje fel és kezelje a manipulációt, azaz hogyan használja a „fénykapcsolót”.

A konstruktív utóhatás: A problémától a pedagógiáig

A trambulinon ugráló medve kísérletét nem lehet önmagában, elszigetelten értékelni. A projekt egy kétlépcsős folyamat első felvonása, ahol a második felvonás a tudatos oktatási és felvilágosító munka. Egy provokáció, amely nem kínál megoldást, puszta cinizmus maradna. Kerek István azonban a kísérlet leleplezését azonnal egy konstruktív cselekvési tervvel egészítette ki, ami alapvetően átformálja a projekt megítélését.

A kísérletre építve egy ingyenes, többnyelvű workshop-sorozat indítását jelentette be, amelynek célja, hogy felvértezze az embereket a digitális korban szükséges tudással. Ez a lépés a provokációt egy globális méretű „tanítható pillanattá” (teachable moment) alakítja át. A medve-videó nem a végcél, hanem a csali, amely felkelti a figyelmet, hogy utána egy sokkal fontosabb üzenetet lehessen átadni a médiaműveltségről, a kritikus gondolkodásról és az MI-etikáról.

Ez a szándék már a korábbi tevékenységeiben is megmutatkozott. A Magyar Kereskedelmi és Iparkamarával (MKIK) közösen indított „Digitális ébresztő” című, mikro-, kis- és középvállalkozásoknak szóló MI-workshop-sorozata is ezt a célt szolgálja: a gyakorlati, kézzelfogható tudás átadását. Ezek a kezdeményezések bizonyítják, hogy Kerek elkötelezett a felvilágosítás mellett, és a trambulinon ugráló medve egy radikális, de tudatos eszköze volt ennek a nagyobb pedagógiai missziónak.

A társadalmi tükör: A digitális állapot diagnózisa

A trambulinon ugráló medve kísérletének sikere nem csupán egy technológiai érdekesség, hanem egy diagnosztikai eszköz, amely kíméletlen pontossággal tárja fel a digitális kor társadalmának mélyen gyökerező sebezhetőségeit. A jelenségre adott tömeges reakció egyfajta társadalmi tükörként funkcionál, amelyben megláthatjuk a bizalom erózióját, a valóságérzékelés bizonytalanságát és a dezinformáció demokratizálódásának következményeit.

A bizalom és a verifikáció válsága

A medve-videóra adott hiszékeny reakció tökéletesen illeszkedik azokhoz a makrotrendekhez, amelyeket a Reuters Institute 2025-ös Digital News Reportja is azonosított.

A cikkünk kulcsfontosságú megállapításai kontextusba helyezik a kísérlet eredményeit:

- A hagyományos média iránti csökkenő elköteleződés: A televízióval, a nyomtatott sajtóval és a hagyományos hírportálokkal szembeni bizalom és elköteleződés folyamatosan csökken, miközben a közösségi média és a videómegosztó platformok szerepe növekszik.

- Az influenszerek és alternatív források felemelkedése: Az online személyiségek, podcasterek és influenszerek egyre inkább megbízható hírforrásként jelennek meg a közönség egy jelentős része számára. Az Egyesült Államokban például a válaszadók 22%-a fogyaszt politikai kommentárt Joe Rogan podcastertől.

- A valóságérzékelés bizonytalansága: A legmegdöbbentőbb adat, hogy a cikkünk szerint a válaszadók 58%-a bizonytalan abban, hogy képes-e megkülönböztetni a valódi és a hamis híreket az interneten.

Kerek István kísérlete ezen statisztikák élő, gyakorlati demonstrációja.

Megmutatta, hogy egyetlen, egyén által létrehozott tartalom hogyan érhet el tömeges hitelességet anélkül, hogy átesne a hagyományos szerkesztőségi vagy tényellenőrzési folyamatokon. A medve-videó sikeresen megkerülte a bizalmi intézményeket, és közvetlenül a felhasználók érzelmeire és előítéleteire hatott, bizonyítva, hogy a digitális térben a verifikáció mechanizmusai rendkívül sérülékenyek.

A dezinformáció demokratizálódása

A kísérlet legfontosabb tanulsága, hogy a meggyőző, valóságtorzító tartalmak előállításának képessége már nem csupán titkosszolgálatok, profi stúdiók vagy állami szereplők privilégiuma. A technológia demokratizálódott, és ma már bárki számára elérhetővé vált.

Ez a dezinformáció korának egy új, veszélyesebb szakaszát jelenti.

Ezt a tendenciát a deepfake technológia robbanásszerű terjedéséről szóló adatok is alátámasztják.

A deepfake-kel kapcsolatos csalási kísérletek száma 3000%-kal nőtt 2023-ban, a felismert deepfake-ek száma pedig megtízszereződött.

A technológiát a legkülönfélébb rosszindulatú célokra használják:

- Zaklatás és kiberbántalmazás: Dél-Koreában komoly problémát jelent, hogy diákok társaik arcával készítenek pornográf videókat.

- Politikai manipuláció: Az amerikai elnökválasztási kampány során Joe Biden hangját klónozták, hogy szavazásra való buzdítás helyett a távolmaradásra szólítsanak fel.

- Pénzügyi csalások: Egy hongkongi pénzügyi szakembert egy deepfake videókonferencia segítségével vettek rá 25 millió dollár átutalására.

A trambulinon ugráló medve videója, bár közvetlen hatásában ártalmatlan, ugyanazt a technológiát demonstrálja, amely ezeket a súlyos társadalmi fenyegetéseket lehetővé teszi. Egy erőteljes figyelmeztetés, hogy a digitális médiába vetett alapvető bizalmunkat milyen könnyen alá lehet ásni. A jelenség rávilágít arra, hogy a valóság és a mesterséges valóság közötti határvonal mára gyakorlatilag elmosódott, és ez a helyzet mindannyiunktól újfajta tudatosságot és felkészültséget követel.

A kísérlet etikája: Szükséges sokk vagy a bizalommal való visszaélés?

A provokáció határai – etikus figyelemfelhívás vagy a közbizalom kockáztatása?

Kerek István és az Adhoc Support CIC közös kísérlete, a trambulinon ugráló AI‑medve videója, nem csupán technológiai teszt volt. Célja egy valós társadalmi problémára való kollektív ébredés kiváltása volt: megmutatni, milyen könnyen vezethetők meg emberek akkor is, ha már úgy érzik, jártasak a digitális világban. A mesterséges videó sikerének kulcsa a „mimikri” volt – vagyis a tudatos utánzás: a videó egy olyan valós tartalomtípust másolt le tökéletesen, amelyhez az emberek már korábbról pozitív, ismerős élményeket társítottak.

Ez a megtévesztés azonban nem öncélú volt, hanem egy társadalmi tükörként funkcionált – és szándékosan idézett elő azt a fajta érzelmi sokkot, amelyet a valóságban sokan már átéltek.

Az Adhoc Support CIC az MBH Bank károsultjaival végzett munkája során ugyanis éppen ennek az élménynek az árnyoldalát tapasztalta meg: több ezer ember lett egy digitálisan tökéletesnek tűnő, de valójában manipulatív csalás áldozata, ahol banki telefonhívások, weboldalak, emailes visszaigazolások és ügyintézők hangjai mind-mind meggyőző mimikri révén építették fel a megtévesztés illúzióját.

A mesterséges medve tehát nem a humor vagy technikai bravúr kedvéért született. Hanem azért, hogy társadalmilag elfogadható, alacsony kockázatú környezetben újraélhetővé tegye azt a pszichológiai mechanizmust, amely valódi károsultak ezreit tévesztette meg. A kísérlet célja így kettős volt: egyrészt felhívni a figyelmet arra, hogy mennyire könnyű félrevezetni embereket – másrészt megadni a lehetőséget arra, hogy ezúttal következmények nélkül tanuljunk a hibából.

Ez a kontraszt teszi a projektet etikai szempontból különlegessé: míg a banki károsultak manipulációja valódi kárt és traumát okozott, a trambulinozó medve videója egyfajta „mentális tűzriadóként” működött – egy előre megtervezett, biztonságos gyakorlatként, amelyből következtetéseket lehetett levonni.

Az Adhoc Support CIC szerint a legnagyobb tanulság nem maga a technológia, hanem annak társadalmi hatása: hogy a valóság illúzióvá, az illúzió valósággá válhat – és csak a közös tudatosság, az együttműködés és a közösségi érdekérvényesítés jelenthet védelmet a digitális manipuláció korában.

A „digitális oltás” esete

Az egyik érvelés, amelyet nagyrészt Kerek István saját indoklása is alátámaszt, a kísérletet egyfajta „társadalmi oltásként” vagy „mentális tűzriadóként” értelmezi. Eszerint a trambulinon ugráló medve egy szükséges sokk volt, amely felébresztette a közvéleményt egy valós és egyre növekvő veszélyre. Az elgondolás lényege, hogy a jövőbeni, rosszindulatú dezinformációs kampányok által okozott potenciális kár (politikai destabilizáció, pénzügyi csalások, társadalmi pánik) sokkal nagyobb, mint a medve-videó által okozott átmeneti, alacsony kockázatú megtévesztés.

Ebben az értelmezésben Kerek egy etikus provokátorként lép fel, aki egy kontrollált, viszonylag ártalmatlan forgatókönyvön keresztül demonstrálja a rendszer sebezhetőségét, mielőtt egy valódi ellenség kihasználná azt. Azáltal, hogy leleplezi saját trükkjét és oktatási programot kínál, a kísérletet a közjó szolgálatába állítja. Az etikai mérlegelés során az okozott csekély sérelmet (a nézők ideiglenes becsapását) felülírja a megelőzött, potenciálisan sokkal nagyobb kár.

A beleegyezés nélküli kísérletezés problémája

A másik oldalról közelítve a kísérlet komoly etikai aggályokat vet fel, különösen a tudományos és társadalmi kutatások etikájának szemszögéből.

Kerek István akciója kísértetiesen hasonlít más, etikailag vitatott digitális kísérletekre:

- A Facebook érzelmi fertőzés kísérlete: 2014-ben a Facebook tudósai manipulálták közel 700 000 felhasználó hírfolyamát, hogy megvizsgálják, a pozitív vagy negatív tartalmak befolyásolják-e az érzelmi állapotukat. A kísérletet a felhasználók beleegyezése nélkül végezték, ami hatalmas felháborodást váltott ki.

- A Reddit r/ChangeMyView kísérlete: Zürichi Egyetem kutatói titokban MI-botokat használtak a Reddit egyik népszerű vitafórumán, hogy embereket megszemélyesítve teszteljék a meggyőzési technikákat. A kísérletet a közösség tudta és beleegyezése nélkül folytatták, ami a közösség bizalmának súlyos megsértéséhez vezetett.

Ezek az esetek egyértelmű etikai keretrendszert biztosítanak a medve-kísérlet kritikájához. A legfontosabb megsértett alapelvek a következők:

- A tájékozott beleegyezés hiánya: A több tízmillió néző nem tudta, hogy egy kísérletben vesz részt. Nem volt lehetőségük dönteni arról, hogy alávetik-e magukat a pszichológiai manipulációnak.

- Megtévesztés: A kísérlet alapja a szándékos megtévesztés volt. Bár a cél nemes lehetett, a módszer etikailag problematikus.

- Hatalmi egyenlőtlenség: A kísérletet egy olyan szakértő irányította, aki minden információ birtokában volt, míg a „kísérleti alanyok” (a globális közönség) teljesen tájékozatlanok voltak. Ez a hatalmi aszimmetria önmagában is etikai kérdéseket vet fel.

A tudományos szakirodalom egyre hangosabban figyelmeztet az „etikai maszatolás” (ethics washing) jelenségére, amikor a jó szándékot pajzsként használják a megkérdőjelezhető módszerek igazolására. A medve-kísérlet kapcsán felmerül a kérdés: ki adhat felhatalmazást egyetlen személynek vagy csoportnak arra, hogy ilyen nagyszabású pszichológiai tesztet végezzen a társadalmon, még ha a célja a felvilágosítás is? A provokáció hatékonysága vitathatatlan, de az alkalmazott módszer etikailag legalábbis a szürke zónába esik.

Párbajozó MI-k: A technológiai célok összehasonlító elemzése

A felhasználói kérés, amely Kerek István mesterséges intelligenciájának és az AdhocSupport CIC rendszerének „keveredését” vizsgálja, egy alapvető választási lehetőségre mutat rá a technológia társadalmi alkalmazásában. A két megközelítés nem csupán technológiailag, hanem filozófiailag is mélyen különbözik. Az egyik az illúziót használja a sebezhetőség feltárására, a másik az adatokat a felhatalmazás megteremtésére. Ez a kontraszt rávilágít a mesterséges intelligencia két arcára.

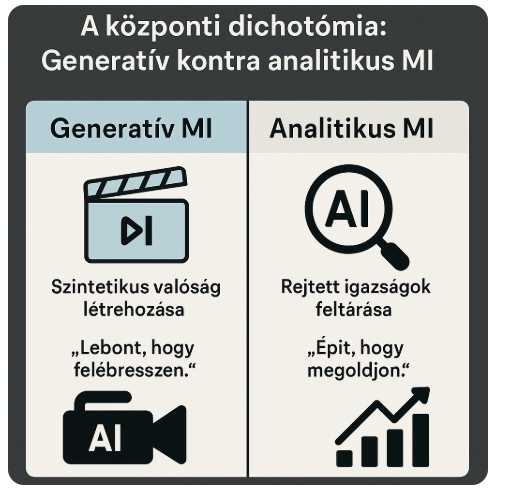

A központi dichotómia: Generatív kontra analitikus MI

A két projekt közötti alapvető különbség a felhasznált MI-technológia típusában és céljában rejlik.

- Kerek István projektje generatív MI-t használt. A szöveg-videó modellek, mint a Google Veo, arra lettek tervezve, hogy szintetikus valóságot hozzanak létre. A cél a közbizalom dekonstrukciója volt egy sokkoló, de tanulságos illúzión keresztül, hogy ezzel elősegítsék az egyéni tudatosságot és kritikai gondolkodást. A technológia itt az illúziókeltés eszköze volt az oktatás érdekében.

- Az AdhocSupport rendszer analitikus MI-t alkalmaz. A természetesnyelv-feldolgozás (NLP), a Big Data elemzés és a mintafelismerés technológiáit arra használják, hogy rejtett igazságokat tárjanak fel a valós világban – például mintázatokat találnak több ezer valódi fogyasztói panaszban. A cél a kollektív erő felépítése és a rendszerszintű igazságszolgáltatás elérése. A technológia itt az elemzés és az érdekérvényesítés eszköze.

Ez a két megközelítés a technológiai spektrum két ellentétes pólusát képviseli. Az egyik lebont, hogy felébresszen, a másik épít, hogy megoldjon.

AdhocSupport: MI a kollektív felhatalmazásért

Az AdhocSupport egy Egyesült Királyságban bejegyzett, nonprofit közösségi érdekű vállalat (Community Interest Company, CIC), amelyet Petrásovits Zoltán és Koczian Géza alapított. A szervezet filozófiáját az „All of us, together!” (Közös erővel, együtt!) és a „You Are Not Alone” (Nem vagy egyedül!) jelmondatok foglalják össze. A küldetésük a fogyasztók és a nagyvállalatok közötti hatalmi aszimmetria kiegyenlítése a technológia és a közösségi összefogás erejével.

Az AdhocSupport MI-rendszerének működése a következő lépésekből áll:

- Adatgyűjtés és elemzés: A platform összegyűjti az egyéni fogyasztói panaszokat.

- Mintafelismerés: Az MI algoritmusok elemzik a beérkezett panaszokat, nyelvi és tartalmi mintázatokat keresve. Képesek azonosítani, ha egy adott termékkel vagy szolgáltatással kapcsolatban tömegesen jelennek meg hasonló problémák, még akkor is, ha a panaszosok nem tudnak egymásról.

- Közösségépítés: A rendszer összeköti azokat a felhasználókat, akik ugyanazzal a problémával szembesülnek, így az elszigetelt, egyéni sérelmekből egy közös, kollektív ügyet formál.

- Érdekérvényesítés: Az így létrejött, adatokkal alátámasztott, tömeges panasz sokkal nagyobb súllyal bír a vállalatokkal vagy hatóságokkal szembeni tárgyalások során. A platform jogi, informatikai és fogyasztóvédelmi szakértői támogatást is nyújt a közösségnek.

Ez a modell a technológiát a transzparencia, a közösségépítés és a konkrét problémamegoldás szolgálatába állítja, ami éles ellentétben áll a medve-kísérlet rejtett, felülről irányított és provokatív jellegével.

Egy új „túlélőkészlet” kovácsolása: Ajánlások a poszt-igazság korszakára

A trambulinon ugráló medve kísérlete és az AdhocSupport modelljének kontrasztja túlmutat az elméleti elemzésen; cselekvésre szólít fel. Kerek István maga is egy új „túlélőkészlet” szükségességét hangsúlyozta. Ez a záró szakasz a diagnózisból a terápia felé mozdul el, és egy többrétegű stratégiát vázol fel a társadalmi ellenállóképesség (reziliencia) kiépítésére a digitális dezinformáció korában.

Az egyének és a civil társadalom számára

A védelem első vonala maga az egyén. A 21. század alapkompetenciái a kritikus gondolkodás, a médiaműveltség és az MI-műveltség. Ennek fejlesztése nemcsak az oktatási rendszer, hanem minden egyén felelőssége is.

- Gyakorlati lépések: A források aktív ellenőrzése, a „laterális olvasás” (amikor egy információt több, független forrásból is megerősítünk), a generatív MI működési alapjainak megértése, és a szintetikus média jeleinek (pl. természetellenes mozgás, hibás árnyékok, furcsa részletek) felismerésének képessége elengedhetetlen.

- A civil társadalom szerepe: Az olyan szervezetek, mint az AdhocSupport, kulcsfontosságúak, mert nemcsak egyéni problémákra kínálnak megoldást, hanem közösséget és tudást is építenek, erősítve a társadalmi szövetet a manipulációval szemben.

Az oktatási szektor számára

A hosszú távú reziliencia alapja a formális oktatás. Sürgető szükség van a digitális és MI-műveltség integrálására az oktatási tantervekbe, az általános iskolától az egyetemig.

- Tantervi integráció: A diákoknak nemcsak a technológia használatát, hanem annak kritikus elemzését is meg kell tanulniuk. Meg kell érteniük az algoritmusok működését, a dezinformáció pszichológiáját és a digitális állampolgárság etikai normáit.

- Public-private partnerségek: Kerek István egyetemi oktatói munkája és az MKIK-val közösen tartott „Digitális ébresztő” workshopjai modellként szolgálhatnak arra, hogyan lehet a piaci szakértelmet és a tudományos szférát bevonni a széles körű oktatásba.

A technológiai platformok számára

A nagy technológiai platformoknak (mint a TikTok, a Facebook vagy a YouTube) óriási felelősségük van a dezinformáció terjedésében, de a megfékezésében is.

- Szabályozási és technológiai intézkedések: Elengedhetetlen az MI által generált tartalmak egyértelmű és transzparens címkézése. A platformoknak többet kell befektetniük a robusztus detekciós technológiákba, és úgy kell módosítaniuk az algoritmusaikat, hogy azok ne a szenzációhajhász, hanem a hiteles, ellenőrzött tartalmakat részesítsék előnyben.

- Iparági együttműködés: A Microsoft, a Google és az OpenAI közös erőfeszítései a deepfake-ek felismerésére jó példát mutatnak, de ezt az együttműködést ki kell terjeszteni az egész iparágra, hogy egységes szabványok és védekezési mechanizmusok jöjjenek létre.

A politikai döntéshozók és szabályozók számára

A jogi kereteknek lépést kell tartaniuk a technológiai fejlődéssel. A merev, technológia-specifikus szabályozás helyett agilis, elv-alapú megközelítésre van szükség, ahogyan azt több AI-kormányzási fehér könyv is javasolja.

- A felelősség tisztázása: A szabályozásnak az MI-eszközök alkalmazására és szándékára kell összpontosítania, nem magára a technológiára. Az MIT által javasolt „villa a kenyérpirítóban” elv szerint egyértelműen meg kell határozni, mikor terheli a felelősség a technológia fejlesztőjét és mikor a végfelhasználót a visszaélésszerű használatért.

- Kettős megközelítés: A jogalkotásnak egyszerre kell szigorúan fellépnie az MI által okozott károkkal (pl. zaklatás, csalás, politikai beavatkozás) szemben, és egyúttal ösztönöznie kell a társadalmilag hasznos alkalmazásokat, mint amilyen az AdhocSupport modellje is. A cél egy olyan szabályozási környezet, amely a bizalmat és az innovációt egyaránt támogatja.

A medvén túl van valóság vagy a 99% miért téved?

A trambulinon ugráló medve sokkal több volt, mint egy mulandó internetes mém. Egy tükör volt, amelyet a digitális társadalom elé tartottak, és amely megmutatta sebezhetőségünket, hiszékenységünket és a hitre való mélyen gyökerező vágyunkat. A kísérlet kíméletlen őszinteséggel tárta fel, milyen törékeny a valóságba vetett bizalmunk egy olyan korban, ahol már semmi sem feltétlenül az, aminek látszik.

A cikkünk központi elemzése, amely a medve-kísérletet az AdhocSupport CIC közösségi érdekérvényesítő modellel állította szembe, rávilágított egy alapvető igazságra: ugyanaz a technológiai forradalom, amely a mesterséges intelligenciát hajtja, gyökeresen eltérő jövőképekhez vezethet. Az MI lehet egy fegyver, amely szétzúzza a bizalmat, vagy egy eszköz, amely közösséget kovácsol. Lehet a megtévesztés és a provokáció motorja, vagy a transzparencia és a megoldás katalizátora.

A végső üzenet egy cselekvésre való felhívás!

A medve talán illúzió volt, de a kihívás, amelyet képvisel, nagyon is valós. A végső felelősség nem a technológiáé, hanem a miénk – egyénekként, közösségekként és társadalmakként –, hogy eldöntsük, melyik jövőt építjük, és hogy aktívan elsajátítsuk és továbbadjuk azt a „túlélőkészletet”, amely a navigációhoz szükséges.

A cél nem az, hogy féljünk a sötéttől, hanem hogy megtanuljuk, közösen, hogyan kell kezelni, ahogyan Kerek István ezt elnevezte a „fénykapcsolót„.